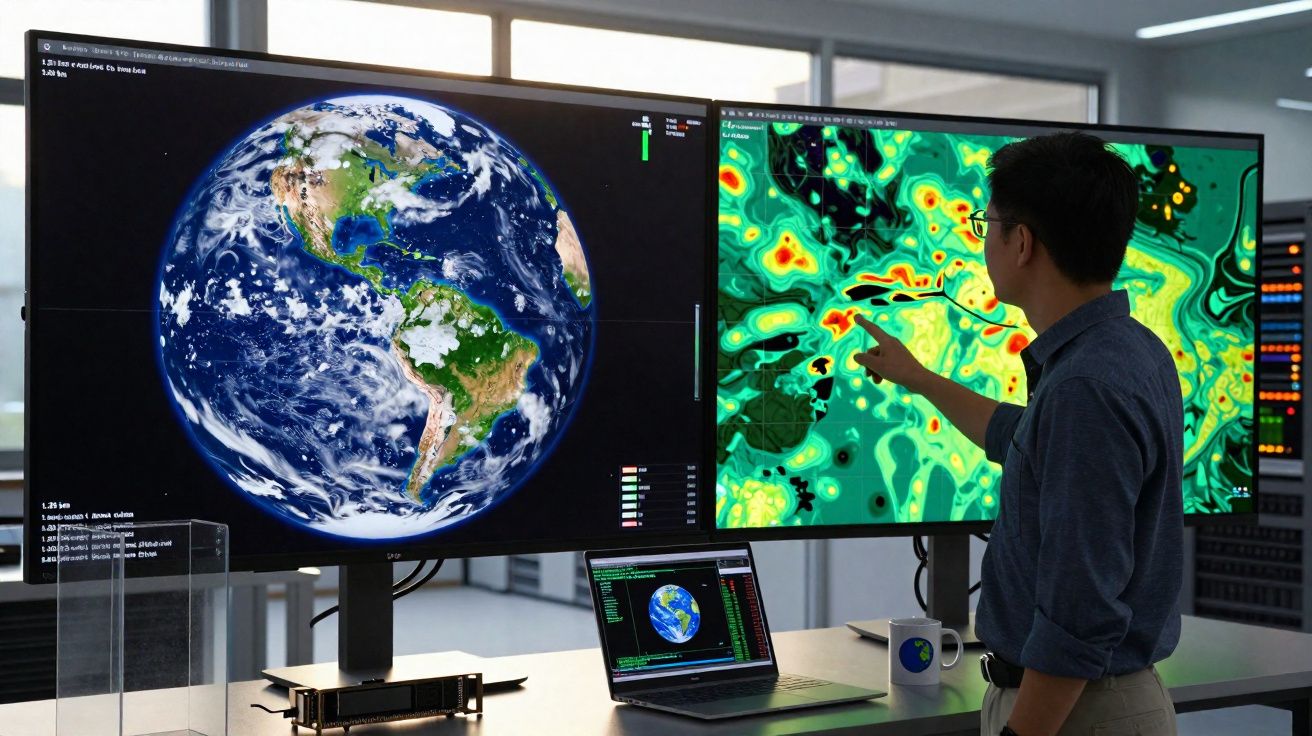

Previsão do tempo e modelagem climática: por que a resolução de 1,25 km pode mudar o jogo

A previsão do tempo é famosa por falhar - e a modelagem do clima consegue ser ainda mais difícil de acertar. Mesmo assim, a capacidade de antecipar o que a natureza pode nos impor vem melhorando de forma constante, principalmente por dois motivos: modelos mais sofisticados e muito mais poder de computação.

Um novo artigo científico, assinado por uma equipa liderada por Daniel Klocke, do Instituto Max Planck (Alemanha), descreve o que alguns especialistas em modelagem climática chamam de o "santo graal" da área: um modelo com resolução quase à escala de quilómetro que integra previsão do tempo e simulações climáticas num único sistema.

Um modelo quase de 1 km - na prática, 1,25 km

Do ponto de vista estritamente técnico, a grelha do novo modelo não chega a 1 km² por parcela simulada: a resolução é de 1,25 km.

Mas, a essa altura, a diferença é quase um detalhe. Para representar toda a superfície terrestre - continentes e oceanos - são estimadas cerca de 336 milhões de células. Os autores acrescentaram o mesmo número de células "atmosféricas" directamente acima das células à superfície, totalizando 672 milhões de células calculadas.

ICON a 1,25 km: como o modelo combina processos "rápidos" e "lentos"

Em cada uma dessas células, os investigadores executaram um conjunto de modelos interligados para reproduzir os principais sistemas dinâmicos do planeta. Eles organizaram esses sistemas em duas classes: "rápidos" e "lentos".

- Os sistemas "rápidos" abrangem os ciclos de energia e de água - em outras palavras, aquilo que percebemos como tempo meteorológico. Para acompanhar esses fenómenos com clareza, é necessária uma resolução extremamente elevada, como os 1,25 km que o novo sistema consegue oferecer.

- Os processos "lentos", por outro lado, incluem o ciclo do carbono e as mudanças na biosfera e na geoquímica dos oceanos. São mecanismos que se manifestam como tendências ao longo de anos ou até décadas, e não em minutos - como o tempo que uma trovoada leva para passar de uma célula de 1,25 km para a seguinte.

Para o componente de alta resolução ligado ao tempo, a base adoptada foi o modelo ICOsahedral Nonhydrostatic (ICON), desenvolvido pelo serviço meteorológico alemão e pelo Instituto Max Planck de Meteorologia.

A ideia central do artigo depende destes conceitos - e é por isso que vale a pena entrar um pouco na parte mais técnica.

O principal avanço: unir o rápido e o lento sem perder viabilidade computacional

Segundo os autores, o verdadeiro salto está em juntar, num mesmo sistema, os processos "rápidos" e "lentos". Em geral, modelos que tentam incorporar esse conjunto de componentes complexos só se tornam viáveis do ponto de vista computacional com resoluções bem mais grossas, superiores a 40 km.

Então, como isto foi possível? A resposta passa por uma combinação de engenharia de software muito detalhada com uma grande dose do hardware mais recente que o dinheiro consegue comprar. A partir daqui, o tema entra no território de software e arquitectura de computação; quem não se interessa por isso provavelmente preferirá avançar.

De Fortran ao DaCe: modernização para computação paralela centrada em dados

O modelo que serviu de base para boa parte do trabalho tinha sido originalmente escrito em Fortran - um pesadelo clássico para quem já precisou modernizar código criado antes de 1990.

Com o tempo, o código foi acumulando extensões e “acessórios” que o tornaram pesado e pouco adequado a arquitecturas computacionais actuais. Para contornar esse bloqueio, os autores optaram por usar uma estrutura chamada Data-Centric Parallel Programming (DaCe), que reorganiza o tratamento dos dados para se encaixar melhor nos sistemas modernos.

Há até uma referência curiosa nesse contexto: Simon Clark testa se um modelo climático consegue correr em hardware muito mais simples - um Raspberry Pi.

JUPITER e Alps com GH200 Grace Hopper: GPU e CPU a trabalhar em conjunto

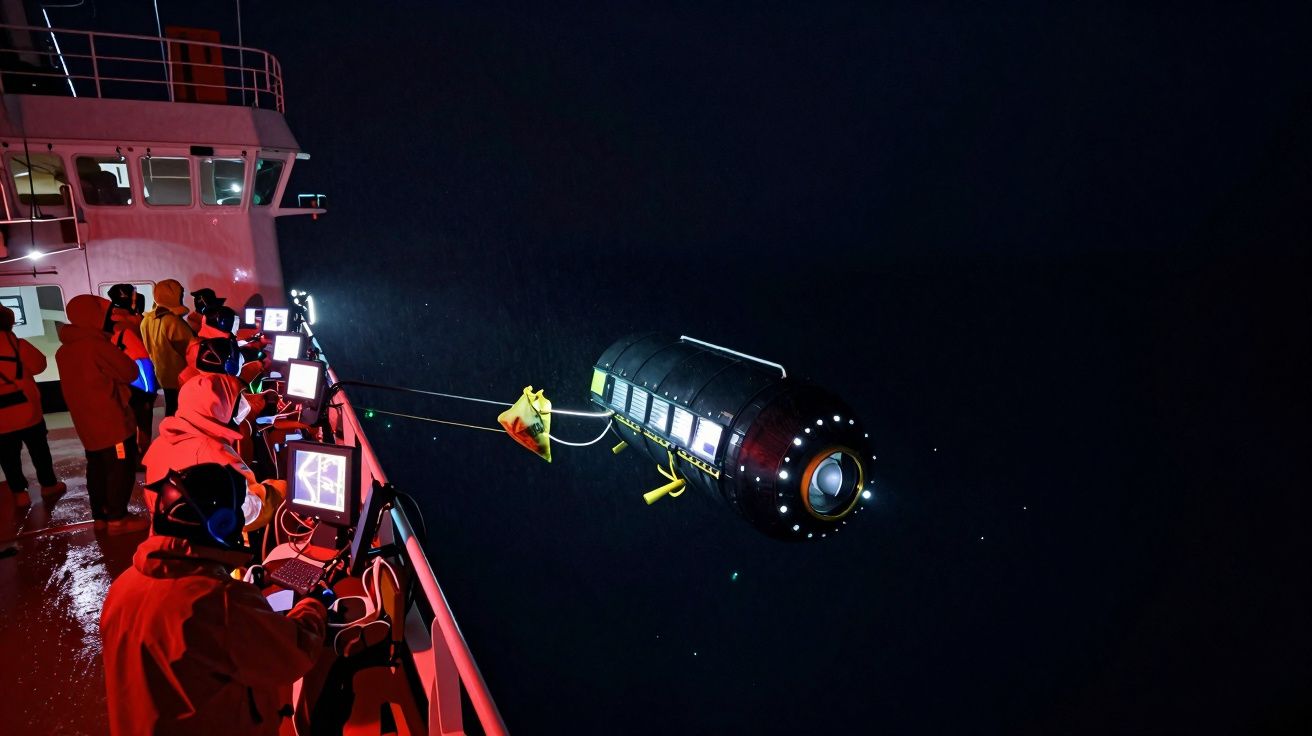

A infraestrutura moderna usada no estudo veio na forma de dois supercomputadores: o JUPITER e o Alps, instalados na Alemanha e na Suíça, respectivamente. Ambos são baseados no novo chip GH200 Grace Hopper, da Nvidia.

Nesses chips, uma GPU (como as usadas no treino de IA - aqui chamada Hopper) vem acompanhada de uma CPU (neste caso de arquitectura ARM, outro fornecedor de chips, e identificada como Grace).

Essa divisão de tarefas e especializações permitiu que os autores executassem os modelos "rápidos" na GPU, acompanhando a necessidade de actualizações frequentes, enquanto os modelos mais lentos, como os do ciclo do carbono, eram sustentados em paralelo pelas CPUs.

Ao separar desse modo o tipo de poder computacional exigido por cada parte, foi possível utilizar 20.480 superchips GH200 para simular, com precisão, 145,7 dias em apenas um dia de execução. Para chegar a esse desempenho, o modelo trabalhou com quase 1 trilhão de "graus de liberdade" - isto é, o número total de valores que precisou calcular. Não é surpresa que um sistema desse nível precise de um supercomputador para funcionar.

O limite prático: isto não vai parar numa estação meteorológica tão cedo

O lado negativo é que modelos com essa complexidade não devem chegar a uma estação meteorológica local num futuro próximo.

Capacidade computacional nesse patamar é difícil de obter e, além disso, grandes empresas de tecnologia tendem a direcionar esses recursos para extrair o máximo possível de IA generativa, independentemente do impacto que isso possa ter na evolução da modelagem climática.

Ainda assim, o feito computacional alcançado pelos autores merece reconhecimento - e fica a esperança de que, um dia, simulações desse tipo se tornem comuns.

A investigação está disponível como pré-publicação no arXiv.

Este artigo foi publicado originalmente pela Universe Today. Leia o artigo original.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário